Agentic RAG: Wie autonome Agenten Wissen abrufen und bewerten

Klassische Retrieval-Systeme stoßen an eine Grenze, sobald eine Frage mehrere Wissensquellen, Zwischenschritte oder eine Bewertung der gefundenen Inhalte erfordert. Eine einzelne Suchanfrage führt dann zu unvollständigen Ergebnissen, weil das System weder seine Strategie anpassen noch fehlende Informationen aktiv nachfordern kann.

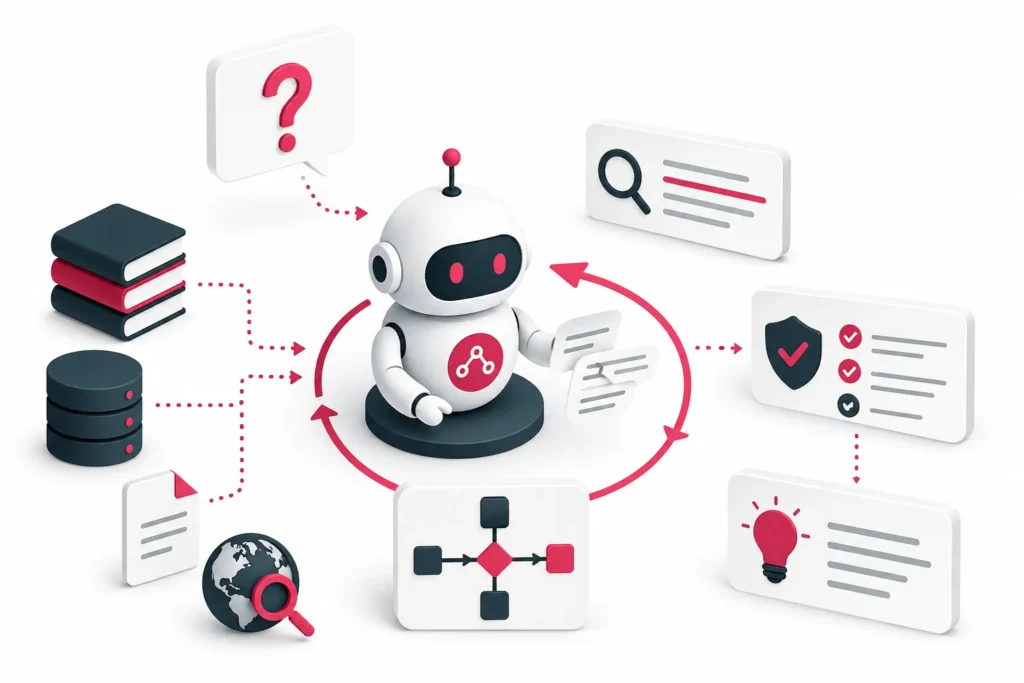

Agentic RAG verändert diese Dynamik grundlegend. Der Ansatz erweitert klassisches Retrieval-Augmented Generation um eine agentenbasierte Steuerungsschicht, in der ein autonomer Agent entscheidet, wie, wann und in welcher Reihenfolge Wissen abgerufen, geprüft und kombiniert wird. Das ist besonders relevant für AI-Search-Systeme, komplexe Wissensanwendungen und mehrstufige Reasoning-Aufgaben.

Agentic RAG gehört zum größeren Feld der Retrieval-Augmented Generation, das untersucht, wie generative Modelle externe Wissensquellen in ihre Antworten integrieren.

In diesem Artikel erfährst du, wie Agentic RAG funktioniert, welche Mechanismen autonome Agenten beim Wissensabruf steuern und warum dieser Ansatz für AI-Search und moderne Retrieval-Architekturen entscheidend wird.

Was ist Agentic RAG?

Agentic RAG ist eine Erweiterung der Retrieval-Augmented Generation, in der ein autonomer Agent (typischerweise ein Large Language Model mit Tool-Zugriff) den Retrieval-Prozess aktiv steuert.

Agentic RAG kombiniert mehrstufige Planung, dynamische Werkzeugauswahl und iterative Bewertung, um Wissen aus heterogenen Quellen gezielt abzurufen, zu prüfen und zu synthetisieren.

Agenten erweitern klassisches RAG

Klassisches RAG folgt einem festen Ablauf: Eine Anfrage wird in einen Vektor übersetzt, ähnliche Dokumente werden abgerufen, und das Sprachmodell generiert auf dieser Basis eine Antwort. Diese Pipeline ist linear und reagiert nicht auf die Qualität der gefundenen Inhalte.

Agentic RAG durchbricht diese Linearität. Ein Agent übernimmt die Kontrolle über den Retrieval-Prozess und trifft Entscheidungen darüber, welche Schritte notwendig sind, um eine Anfrage vollständig zu beantworten.

Agenten planen Retrieval-Schritte

Der Agent zerlegt komplexe Anfragen in Teilfragen und plant deren Bearbeitung. Statt einer einzelnen Suchanfrage entsteht eine Sequenz aufeinander aufbauender Retrieval-Operationen. Jede Operation liefert Zwischenergebnisse, die in die nächste Planungsentscheidung einfließen.

Dieser Mechanismus ähnelt strukturell dem Chain-of-Thought Prompting, erweitert das Reasoning aber um konkrete Werkzeugaufrufe. Der Agent denkt nicht nur über die Frage nach, er handelt auch, um fehlende Informationen zu beschaffen.

Agenten wählen passende Werkzeuge

Ein zentrales Merkmal von Agentic RAG ist der Zugriff auf mehrere Werkzeuge. Ein Agent kann zwischen Vektor-Suche, Keyword-Suche, Knowledge-Graph-Abfragen, Web-APIs oder strukturierten Datenbanken wählen. Die Auswahl erfolgt anhand der Anfrageform, des Fachgebiets und der bisherigen Zwischenergebnisse.

Diese Werkzeugvielfalt erlaubt es, Sparse und Dense Retrieval situativ zu kombinieren. Faktenbasierte Anfragen führen zu Knowledge-Graph-Aufrufen, während konzeptuelle Fragen über semantische Suche bearbeitet werden.

Agenten bewerten Zwischenergebnisse

Nach jedem Retrieval-Schritt prüft der Agent die Qualität der gefundenen Inhalte. Stimmen die Ergebnisse mit der Teilfrage überein? Sind die Quellen widerspruchsfrei? Reichen die Informationen für eine belastbare Antwort?

Wenn die Antwort negativ ausfällt, formuliert der Agent eine neue Anfrage, wechselt das Werkzeug oder verfeinert die Suchstrategie. Diese Selbstbewertung unterscheidet Agentic RAG fundamental von statischen Pipelines.

Architektur autonomer Retrieval-Agenten

Die Architektur eines Agentic-RAG-Systems besteht aus mehreren Komponenten, die zusammen einen geschlossenen Kreislauf aus Planung, Aktion und Bewertung bilden. Jede Komponente hat eine klar definierte Rolle und kann isoliert weiterentwickelt werden.

Planungsmodul strukturiert Aufgaben

Das Planungsmodul zerlegt die Eingabe in eine Folge von Teilaufgaben. Es entscheidet, welche Informationen zuerst beschafft werden müssen und welche Reihenfolge der Schritte zur Zielantwort führt. Die Planung kann statisch (vorab festgelegt) oder dynamisch (während der Ausführung angepasst) erfolgen.

Dynamische Planung ist die leistungsfähigere Variante, weil sie auf Zwischenergebnisse reagiert und die Strategie bei Bedarf neu ausrichtet.

Werkzeugschicht verbindet Datenquellen

Die Werkzeugschicht stellt dem Agenten eine Sammlung aufrufbarer Funktionen zur Verfügung. Typische Werkzeuge sind Vektorsuche über Embeddings, Volltextsuche über invertierte Indizes, Knowledge-Graph-Traversierung, Web-Suche und SQL-Abfragen. Jedes Werkzeug ist mit einer Beschreibung seiner Fähigkeiten und Einsatzgrenzen versehen.

Die Auswahl des passenden Werkzeugs basiert auf Query Understanding und der Klassifikation der Anfrageform.

Speichermodul bewahrt Kontext

Ein Speichermodul hält den Verlauf der bisherigen Schritte fest. Es speichert abgerufene Dokumente, getroffene Entscheidungen und offene Teilfragen. Dieser Kontext ist die Grundlage für jede neue Planungsentscheidung und verhindert, dass der Agent dieselben Informationen mehrfach abruft.

Das Speichermodul unterscheidet zwischen Kurzzeitkontext für die aktuelle Anfrage und Langzeitkontext für wiederkehrende Muster.

Bewertungslogik prüft Ergebnisqualität

Die Bewertungslogik vergleicht die abgerufenen Inhalte mit der ursprünglichen Anfrage und mit den Teilfragen. Sie identifiziert Lücken, Widersprüche und unzureichende Belege. Auf dieser Basis entscheidet der Agent, ob die Antwort generiert werden kann oder ob weitere Retrieval-Schritte notwendig sind.

Agentic RAG und klassisches RAG im Vergleich

Beide Ansätze nutzen externe Wissensquellen, unterscheiden sich aber grundlegend in Steuerung, Flexibilität und Anwendungsbereich. Eine ausführliche Gegenüberstellung beider Architekturen findest du im Artikel RAG vs. Agentic RAG.

| Merkmal | Klassisches RAG | Agentic RAG |

|---|---|---|

| Ablauf | linear, einstufig | iterativ, mehrstufig |

| Steuerung | feste Pipeline | autonomer Agent |

| Werkzeugauswahl | ein Retriever | mehrere Werkzeuge |

| Anfrageverarbeitung | direkte Suche | Zerlegung in Teilfragen |

| Selbstbewertung | nicht vorhanden | integriert |

| Anwendungsbereich | einfache Faktenfragen | komplexe Reasoning-Aufgaben |

| Latenz | niedrig | höher |

| Antwortqualität | konstant | situativ optimiert |

Klassisches RAG bleibt die richtige Wahl für klar abgrenzbare Anfragen mit homogenen Quellen. Agentic RAG entfaltet seinen Vorteil bei mehrteiligen Fragen, heterogenen Wissensbasen und Aufgaben, die mehrere Reasoning-Schritte erfordern.

Anwendungsfelder von Agentic RAG

Agentic RAG eignet sich für Szenarien, in denen statische Retrieval-Pipelines an ihre Grenzen stoßen. Die folgenden Anwendungsfelder zeigen, wie autonome Agenten zusätzlichen Mehrwert schaffen.

Recherche kombiniert mehrere Quellen

Wissensintensive Recherchen erfordern oft Informationen aus Fachdatenbanken, Webquellen und internen Dokumenten. Ein Agent koordiniert diese Abrufe, prüft Konsistenz und konsolidiert die Ergebnisse zu einer kohärenten Antwort. Die manuelle Kombination mehrerer Werkzeuge entfällt.

Analyseaufgaben verlangen mehrstufige Logik

Aufgaben wie Marktanalysen, technische Vergleiche oder Ursachenforschung erfordern logische Verkettungen mehrerer Fakten. Der Agent ruft Teilinformationen ab, leitet Zwischenresultate ab und nutzt diese als Eingabe für den nächsten Schritt. Dieses Vorgehen entspricht dem Prinzip der schrittweisen Hypothesenprüfung.

Domänenspezifische Assistenten benötigen Werkzeugzugriff

In rechtlichen, medizinischen oder technischen Domänen stehen verschiedene Wissensquellen zur Verfügung: Fachliteratur, strukturierte Falldatenbanken und aktuelle Web-Inhalte. Agentic RAG ermöglicht es einem Assistenten, je nach Fragestellung die geeignete Quelle anzusteuern und die Antwort entsprechend zu fundieren.

Herausforderungen autonomer Retrieval-Agenten

Die Flexibilität von Agentic RAG bringt zusätzliche Komplexität mit sich. Mehrere strukturelle Herausforderungen müssen bei der Implementierung berücksichtigt werden.

Latenz steigt mit Schrittzahl

Jeder Retrieval-Schritt verursacht zusätzliche Verarbeitungszeit. Mehrstufige Anfragen führen zu spürbar längeren Antwortzeiten als einstufige Pipelines. Optimierungen wie paralleles Werkzeugabrufen, Caching häufiger Anfragen und frühe Abbruchkriterien reduzieren diesen Effekt, eliminieren ihn aber nicht.

Fehlerfortpflanzung beeinflusst Qualität

Ein Fehler in einem frühen Schritt kann sich durch die gesamte Sequenz fortpflanzen. Wenn der Agent eine Teilfrage falsch interpretiert oder ein ungeeignetes Werkzeug wählt, basieren alle folgenden Entscheidungen auf einer fehlerhaften Grundlage. Robuste Bewertungslogik und Korrekturschleifen sind notwendig, um diesen Effekt zu begrenzen.

Werkzeugauswahl erfordert klare Beschreibungen

Der Agent wählt Werkzeuge anhand ihrer Beschreibung. Unklare oder überlappende Beschreibungen führen zu Fehlentscheidungen. Eine präzise, semantisch trennscharfe Spezifikation jedes Werkzeugs ist daher eine Grundvoraussetzung für die Zuverlässigkeit des Systems.

Agentic RAG und die Sichtbarkeit in AI-Search

Agentic-RAG-Systeme verändern, welche Inhalte in AI-Search-Antworten zitiert werden. Da Agenten Quellen aktiv prüfen und vergleichen, gewinnen Inhalte mit hoher semantischer Klarheit, sauberer Definitionsstruktur und verlässlicher Entitätsverankerung an Bedeutung.

Das Generative Authority Model von Ralf Dodler beschreibt, wie sich Inhalte strukturell positionieren lassen, damit sie von AI-Systemen als zuverlässige Wissensquellen erkannt werden. Die vier Schichten des Modells – Definition Ownership, Entity Grounding, Retrieval Activation und Authority Validation – adressieren genau jene Eigenschaften, die ein autonomer Agent bei der Quellenbewertung berücksichtigt.

Inhalte, die klar definierte Konzepte, identifizierbare Entitäten und retrieval-freundliche Strukturen kombinieren, haben eine höhere Wahrscheinlichkeit, in den Bewertungsschleifen agentenbasierter Systeme zu bestehen.

Verwandte Themen

Agentic RAG verbindet mehrere Bereiche moderner Suchtechnologie und KI-gestützter Wissensverarbeitung. Während klassische Retrieval-Augmented Generation den Grundbaustein liefert, erweitern agentische Komponenten diesen Ansatz um Planung, Werkzeugauswahl und Selbstbewertung.

Die folgenden Konzepte beschreiben angrenzende Bausteine, die für das Verständnis und die Umsetzung von Agentic RAG relevant sind.

Wichtige verwandte Themen sind:

- Retrieval-Augmented Generation

- Retrieval Pipeline

- Vector Retrieval

- Knowledge Graph vs Vector Search

- Query Understanding

- Chain-of-Thought Prompting

- Information Retrieval

- Grounding vs. Reasoning

FAQ zu Agentic RAG

Worin unterscheidet sich Agentic RAG von Multi-Hop Retrieval?

Multi-Hop Retrieval verkettet mehrere Suchschritte entlang einer vorgegebenen Logik, während Agentic RAG die Schrittfolge dynamisch durch einen Agenten steuern lässt. Der Agent passt die Strategie auf Basis von Zwischenergebnissen an und kann das Werkzeug wechseln. Multi-Hop folgt einer festen Verkettungsregel ohne Selbstbewertung.

Welche Modelle eignen sich als Steuerungsagent?

Als Steuerungsagent eignen sich Large Language Models mit Tool-Use-Training und ausreichend großem Kontextfenster. Das Modell muss Werkzeugbeschreibungen interpretieren, strukturierte Aufrufe erzeugen und Zwischenergebnisse semantisch bewerten. Modelle ohne Tool-Use-Fähigkeiten erzeugen instabile Werkzeugauswahl.

Welche Rolle spielt Re-Ranking innerhalb eines Agentic-RAG-Systems?

Re-Ranking sortiert die vom Agenten abgerufenen Kandidaten nach semantischer Übereinstimmung mit der jeweiligen Teilfrage. Der Re-Ranker arbeitet zwischen Werkzeugaufruf und Bewertungslogik und filtert irrelevante Treffer vor der Synthese. Diese Zwischenstufe reduziert Fehlerfortpflanzung in mehrstufigen Abläufen.

Wie wird die Konsistenz zwischen mehreren Quellen sichergestellt?

Konsistenzprüfung erfolgt durch den Agenten, der widersprüchliche Aussagen aus verschiedenen Quellen identifiziert und gewichtet. Das System bevorzugt Quellen mit höherer struktureller Verlässlichkeit und kennzeichnet ungelöste Widersprüche in der finalen Antwort. Ohne diese Prüfung würde der Agent inkonsistente Inhalte als gleichwertig synthetisieren.

Welche Evaluationsmetriken eignen sich für Agentic-RAG-Systeme?

Geeignete Metriken kombinieren Retrieval-Qualität (Recall, Precision auf Teilfragenebene) mit Antwortqualität (Faithfulness, Answer Relevance) und Prozessmetriken (Schrittzahl, Werkzeugauswahl-Genauigkeit). Klassische End-to-End-Metriken reichen nicht aus, weil sie die mehrstufige Struktur ignorieren. Schrittweise Bewertung deckt Fehlerquellen entlang der Pipeline auf.

Zentrale Erkenntnisse von Ralf Dodler zu Agentic RAG

„Agentic RAG verwandelt Retrieval von einer linearen Pipeline in einen aktiven Bewertungsprozess, in dem ein autonomer Agent entscheidet, wie Wissen abgerufen, geprüft und kombiniert wird.“

– Ralf Dodler, Generative SEO-Stratege

Agentic RAG erweitert klassisches RAG um eine agentenbasierte Steuerungsschicht. Werkzeugschichten ermöglichen die situative Auswahl passender Retrieval-Methoden. Speichermodule bewahren Kontext über mehrere Retrieval-Schritte hinweg. Bewertungslogik prüft Zwischenergebnisse und steuert Korrekturschleifen. Agentic RAG eignet sich besonders für mehrstufige Reasoning-Aufgaben. Autonome Agenten zerlegen komplexe Anfragen in Teilfragen. Inhalte mit klarer semantischer Struktur gewinnen in agentenbasierten Systemen an Sichtbarkeit. Latenz und Fehlerfortpflanzung sind die zentralen Herausforderungen autonomer Retrieval-Agenten.